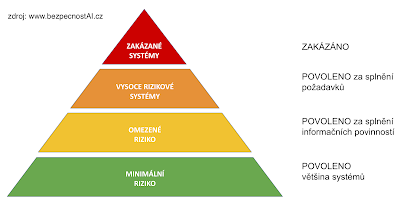

Vítejte u dnešní epizody podcastu zaměřené na nařízení Evropské unie, které reguluje umělou inteligenci – AI Act. Tento právní rámec si klade za cíl zajistit bezpečnost a odpovědné využití AI systémů, přičemž zavádí čtyři úrovně rizika. Tyto úrovně definují, jakým způsobem lze systémy umělé inteligence používat, a co musí splňovat, aby byly legální. Dnes si podrobněji rozebereme všechny čtyři kategorie: nepřijatelné riziko, vysoce rizikové systémy, omezené riziko a minimální riziko.

Kurzy na AI Act & digitální gramotnost

Nepřijatelné riziko

Začněme nejvyšší kategorií – systémy s nepřijatelným rizikem. Jak už název napovídá, tyto systémy jsou zakázány, protože jejich používání by mohlo vážně ohrozit lidská práva, bezpečnost nebo zdraví. Patří sem například:

- Manipulativní techniky: Jde o systémy, které využívají podprahové vlivy nebo manipulativní metody k ovlivnění lidského chování. Představte si třeba AI, která nutí uživatele k nevýhodným rozhodnutím, jako je nákup nebezpečného produktu.

- Sociální kreditní systémy: Známe je například z některých zemí, kde hodnotí chování občanů a na základě toho jim umožňují nebo naopak zakazují přístup ke službám.

- Biometrická identifikace na dálku: To jsou systémy, které by mohly například sledovat osoby na veřejnosti pomocí rozpoznávání obličejů. Tyto technologie jsou v EU zakázané, s výjimkou určitých specifických případů, jako je hledání pohřešovaných osob.

Tato kategorie zajišťuje, že systémy, které by mohly být zneužity ke kontrole, manipulaci nebo diskriminaci, nemají v EU místo.

Vysoce rizikové systémy

Pojďme na druhou úroveň – vysoce rizikové systémy. Tyto systémy jsou povolené, ale pouze za velmi přísných podmínek. Tady už jde o technologie, které mají potenciál výrazně ovlivnit životy lidí.

Příkladem jsou:

- Systémy používané při zaměstnávání: Například AI, která vyhodnocuje uchazeče o práci nebo sleduje výkonnost zaměstnanců.

- Veřejné služby: Jde o systémy, které rozhodují o nárocích na sociální dávky nebo zdravotní péči.

- Hodnocení úvěrové schopnosti: Tady mluvíme o AI, která automaticky rozhoduje o schvalování úvěrů.

Tyto systémy musí splňovat řadu požadavků: například být registrovány v evropské databázi, projít posouzením shody a podléhat pravidelnému monitoringu. Důraz je kladen také na transparentnost, aby uživatelé chápali, jak systém funguje, a měli možnost ho kontrolovat.

Omezené riziko

Přecházíme k méně přísně regulované kategorii – omezenému riziku. Tyto systémy jsou také povolené, ale jejich používání je podmíněno informačními povinnostmi.

Jinými slovy, uživatelé musí být informováni o povaze a účelu systému, aby přesně věděli, co mohou očekávat. Příkladem jsou:

- Chatboti: Pokud komunikujete s chatbotem, musí vám být jasně sděleno, že na druhé straně není člověk, ale AI.

- Interaktivní systémy: Například aplikace, které poskytují základní informace nebo služby pomocí AI.

Tato kategorie zdůrazňuje potřebu transparentnosti. I když tyto systémy nepředstavují zásadní riziko, je důležité, aby byly uživatelům jasné hranice jejich fungování.

Minimální riziko

A nakonec se dostáváme k nejméně rizikové kategorii. Systémy s minimálním rizikem tvoří největší část běžně používané AI. Tyto technologie jsou povoleny bez zvláštních regulací, protože nepředstavují žádné významné riziko pro jednotlivce ani společnost.

Příklady zahrnují:

- Doporučovací algoritmy: Například AI, která vám na základě vašich preferencí doporučuje filmy na streamovacích platformách.

- Personalizované reklamy: Algoritmy, které vybírají reklamy podle vašich zájmů a chování na internetu.

Tyto systémy jsou uživatelsky přívětivé, běžně dostupné a nejsou regulovány tak přísně jako ostatní kategorie.

Závěr

Klasifikace rizik podle AI Act ukazuje, že Evropská unie bere umělou inteligenci velmi vážně. Od zakázaných systémů s nepřijatelným rizikem přes přísně regulované vysoce rizikové technologie až po běžné aplikace s minimálním rizikem – každá úroveň má své jasné pravidla.

Děkuji, že jste si dnešní epizodu poslechli. Pokud vás zajímá více o regulacích AI nebo chcete slyšet o dalších tématech z oblasti technologií a legislativy, zůstaňte s námi a těšte se na další díly. Na slyšenou příště!

Další informace na blogu BezpečnostAI